A finales del siglo XIX, la física clásica parecía explicar casi todo, pero empezaron a aparecer problemas que no encajaban.

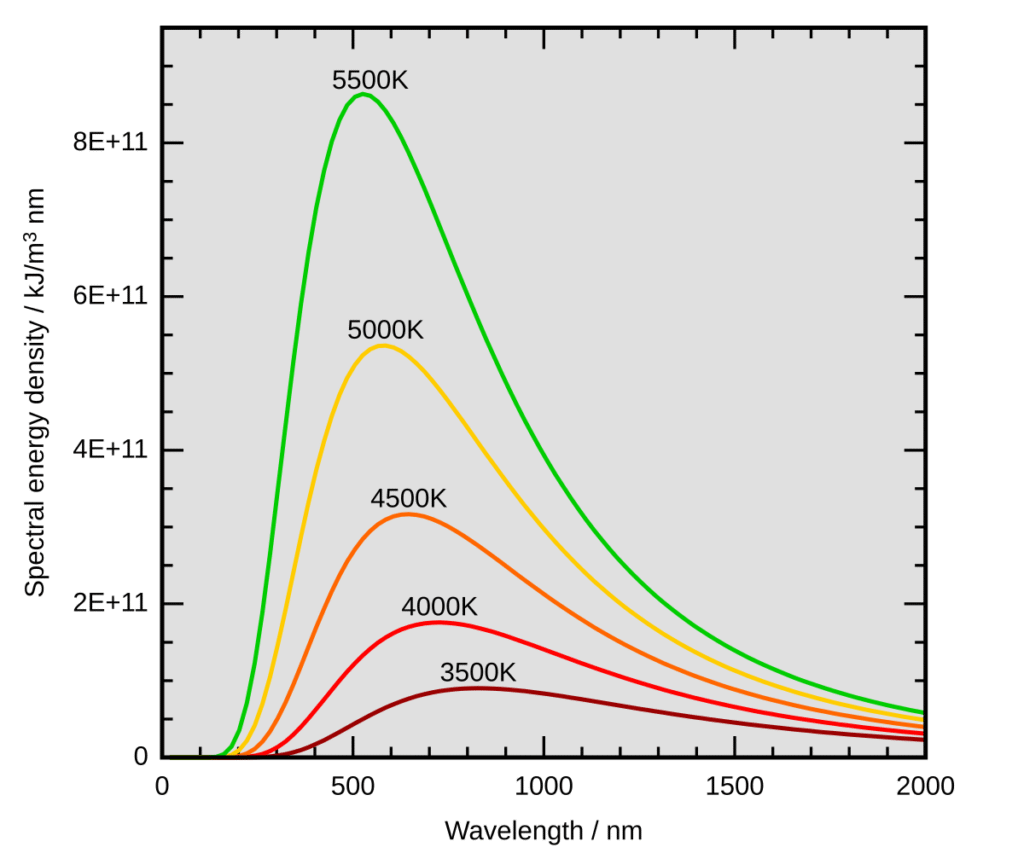

Uno de ellos era que la física clásica predecía que un cuerpo caliente debía emitir energía infinita a frecuencias altas, algo claramente imposible y contrario a los experimentos.

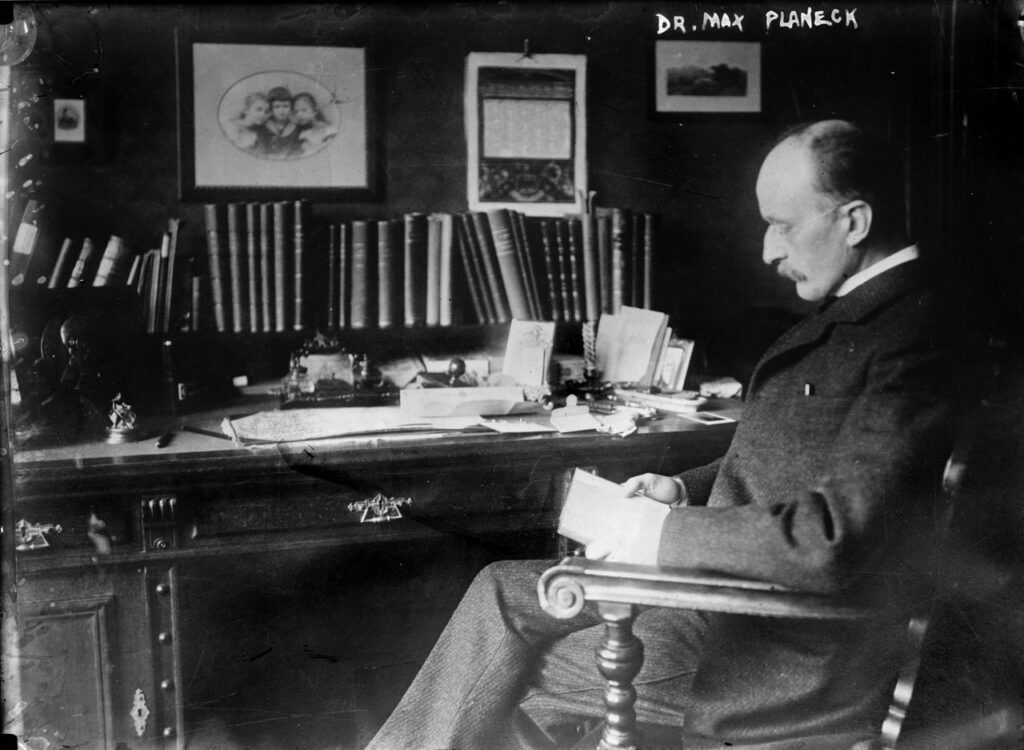

Para resolverlo, Max Planck propuso en 1900 que la energía no se emite de forma continua, sino en paquetes discretos llamados cuantos.

Esta idea eliminó la divergencia infinita y marcó el nacimiento de la mecánica cuántica, mostrando que la física clásica no bastaba para describir el mundo microscópico.

La energía, y con ella la materia y la radiación, tienen una estructura granular en su nivel más fundamental, marcando el inicio de la física cuántica.

En 1905, Albert Einstein fue más lejos al explicar el efecto fotoeléctrico afirmando que la luz, además de comportarse como onda, se comporta como partícula. Así nacía el concepto de fotón. La luz dejaba de ser solo una vibración del campo electromagnético para adquirir una naturaleza dual.

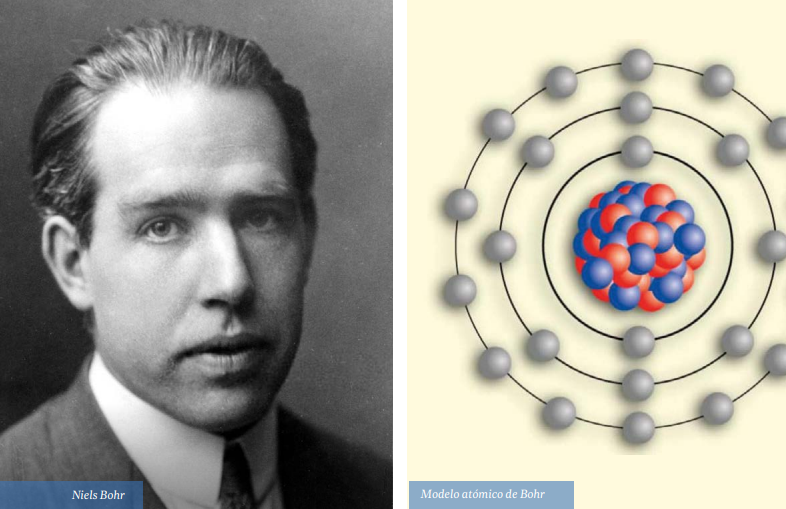

Poco después, el físico danés Niels Bohr en 1913 propuso el modelo del átomo de Bohr, y siguió demostrando la existencia del límite: los electrones giran alrededor del núcleo en órbitas cuantizadas y solo emiten o absorben energía al saltar de una órbita a otra.

Durante la década de 1920, Louis de Broglie siguió con la dualidad al sugerir que la materia, posee una dualidad onda-partícula: indica que la luz y las partículas elementales, como los electrones, no se comportan siempre de la misma manera.

Poco después, Werner Heisenberg desarrolló la mecánica matricial y formuló el principio de incertidumbre, que establece que no es posible conocer con precisión absoluta y simultánea la posición y la velocidad de una partículas, así como otras propiedades asociadas. No se trata de una limitación técnica, sino de un rasgo fundamental de la naturaleza en su nivel más profundo.

Esto ocurre porque las partículas no siguen trayectorias bien definidas como en la física clásica, sino que están descritas por estados ondulatorios.

En el mundo cuántico no podemos saber con certeza dónde está una partícula o qué valor tendrá una magnitud, sino la probabilidad de encontrarla en un lugar o estado determinado.

Así, la ecuación no predice “qué pasa seguro”, sino qué es más o menos probable que pase cuando hacemos una medición.

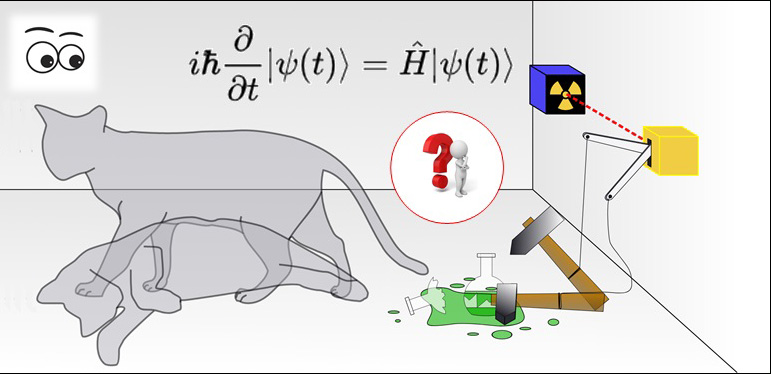

Erwin Schrödinger describió cómo evoluciona esta función de onda, una herramienta matemática que contiene toda la información posible sobre un sistema. Esta función no describe trayectorias concretas, sino probabilidades. El estado de una partícula no está definido hasta que se mide, y el acto de medir juega un papel esencial en el resultado observado.

El gato de Schrödinger es un experimento mental que ilustra lo extraño de la mecánica cuántica: un gato encerrado en una caja, junto a un mecanismo que depende de un evento cuántico, está simultáneamente vivo y muerto hasta que alguien abre la caja y lo observa. No se trata de un gato mágico, sino de mostrar que, a nivel cuántico, las partículas existen en superposición de estados, y que solo al interactuar con el mundo exterior se “decide” un resultado.

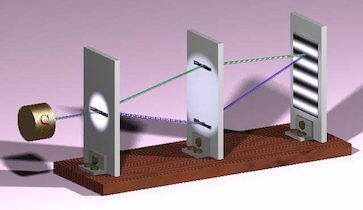

El experimento de la doble rendija revela la extraña naturaleza de la luz y la materia: cuando partículas como electrones o fotones pasan por dos rendijas, no se comportan como pequeñas bolas, sino que generan un patrón de interferencia, típico de ondas. Sorprendentemente, si se intenta observar por cuál rendija pasa cada partícula, el patrón de ondas desaparece y se comportan como partículas.

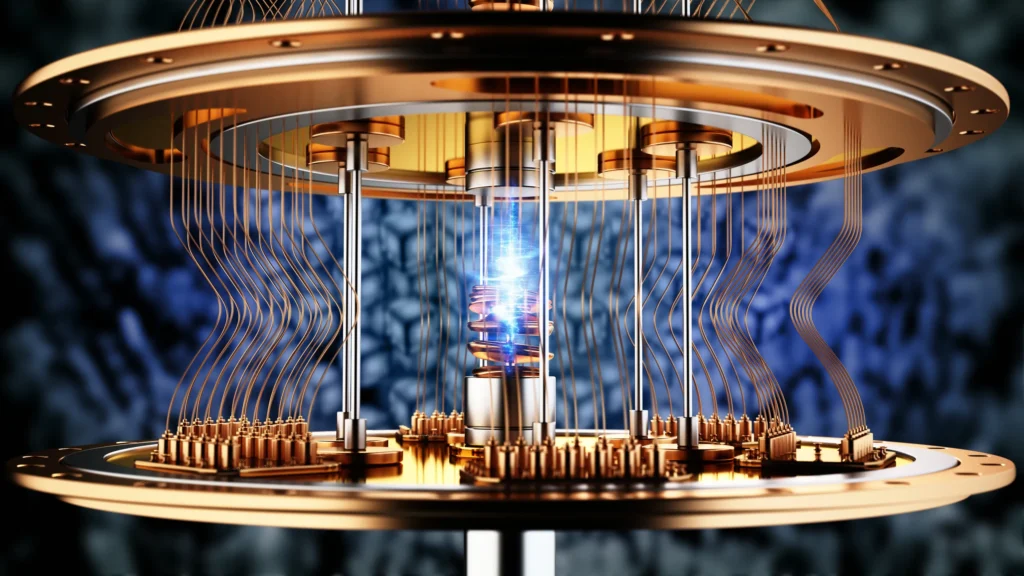

La MC es la teoría más fascinante y a la vez más comprobada de la historia. Esta visión, aunque contraintuitiva, es hoy la base de gran parte de la tecnología moderna. Es la base de los computadores cuánticos, donde los qubits pueden representar 0 y 1 a la vez, multiplicando exponencialmente la capacidad de cálculo en comparación con los sistemas clásicos.

Sin embargo el fenómeno más asombroso es el entrelazamiento cuántico, descrito en la paradoja de Einstein-Podolsky-Rosen en 1935 y John Bell en la década de 1960.

Las que partículas que han interactuado pueden permanecer conectadas de forma que medir una afecta instantáneamente a la otra, ¡sin importar la distancia!. Este fenómeno es la base de la criptografía cuántica y las futuras redes de comunicación cuántica.

Esta no-localidad desafía nuestra intuición clásica de que la información solo viaja a velocidades finitas y cuestiona la idea de una realidad independiente y local.

En otras palabras, la naturaleza parece ser más interconectada y relacional de lo que percibimos: los sistemas cuánticos no existen de manera aislada. Cuando dos o más partículas quedan conectadas de tal forma no actúan como objetos separados, sino como un solo sistema cuántico.

Cuando dos partículas interactúan y se generan juntas, sus propiedades quedan descritas por una sola función de onda común, no por estados independientes. Esto hace que el sistema conserve leyes fundamentales como la conservación de la energía, el momento y el espín.

En otras palabras, la naturaleza cuántica no separa completamente lo que ha estado unido: la correlación permanece incluso cuando las partículas se separan.

En los últimos años, el entrelazamiento cuántico ha sido demostrado incluso a grandes distancias, validando la no localidad predicha por la teoría y permitiendo avances reales en comunicación cuántica y criptografía. La violación de las desigualdades de Bell ha sido confirmada en experimentos cada vez más precisos, descartando explicaciones clásicas basadas en variables ocultas locales. También se ha observado con alto control la superposición cuántica en sistemas cada vez más grandes, desde moléculas complejas hasta dispositivos macroscópicos enfriados a temperaturas extremas.

La Interpretación de Copenhague, formulada por Niels Bohr y sus colegas, propuso que los sistemas cuánticos no tienen propiedades definidas hasta que se miden. no existe un “estado objetivo” independiente de la interacción con el entorno.

En mecánica cuántica, el tiempo sigue existiendo como un parámetro que marca la evolución de los sistemas, pero deja de ser un escenario absoluto como en la física clásica o la relatividad. Las partículas y sus estados no avanzan en trayectorias definidas; en cambio, su función de onda evoluciona probabilísticamente con el tiempo, y solo al medirse se obtiene un resultado concreto. Esto significa que el tiempo sigue siendo útil para describir cambios y procesos, pero la realidad cuántica nos muestra que no fluye de manera fija y uniforme para los sistemas más fundamentales, cuestionando nuestra intuición de un tiempo “independiente” y absoluto.

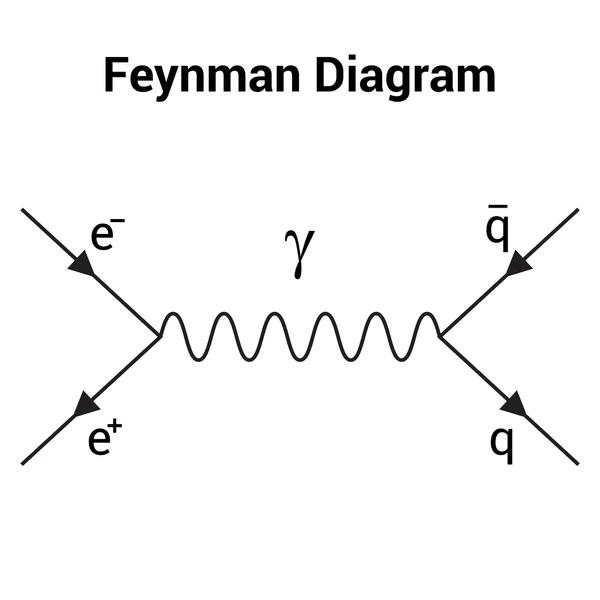

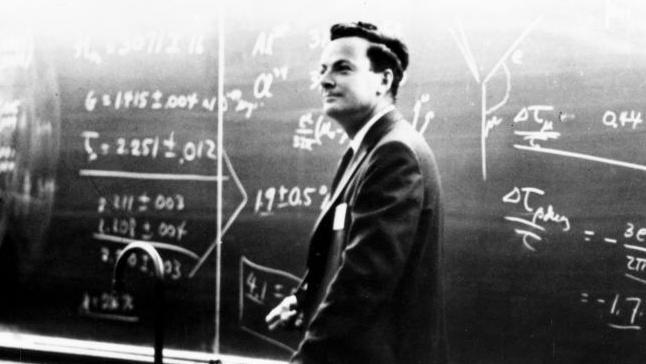

Según Richard Feynman, la materia se relaciona principalmente a través de interacciones cuánticas entre partículas, que pueden entenderse como intercambios de “mensajeros” llamados bosones, responsables de las fuerzas fundamentales.

Los electrones, quarks y otras partículas no actúan de forma aislada; su comportamiento está determinado por la probabilidad de que intercambien fotones, gluones o bosones W y Z, y estas interacciones cuánticas explican cómo se forman átomos, moléculas y estructuras mayores. Para Feynman, incluso conceptos como la fuerza o el campo son maneras de describir patrones de relación entre partículas, y el mundo material es esencialmente un entramado de intercambios dinámicos de energía y momento, gobernados por las leyes de la mecánica cuántica y expresados elegantemente en sus diagramas de interacción.

No hay evidencia científica de una “conciencia cuántica”. La mecánica cuántica describe partículas y probabilidades, mientras que la conciencia emerge de la actividad del cerebro o más elevada. Ideas que mezclan ambos campos son interpretaciones que hasta ahora no forman parte de la ciencia. Sin embargo, algunas teorías contemporáneas, como la Orch-OR propuesta por Roger Penrose y Stuart Hameroff, sugieren que ciertos procesos cuánticos podrían ocurrir en estructuras llamadas microtúbulos dentro de las neuronas, influyendo en la información que procesa el cerebro.

El desarrollo de la computación cuántica ha demostrado de manera práctica la coherencia y el control de estados cuánticos, mientras que experimentos recientes confirman la existencia y manipulación de fases topológicas de la materia, ampliando nuestra comprensión de los estados cuánticos colectivos.

CONCLUSIONES

También en el universo de lo pequeño se necesita un límite, el cuanto, para no llegar al infinito que es absurdo o imposible.

Existe una naturaleza dual: la luz, lo único sin masa, es onda y partícula.

Este comportamiento no depende de un cambio real del objeto, sino de cómo se lo observa y mide: el obeservador cambia o defina la realidad.

Medir altera la realidad.

La posición de la partícula no esta determinada, sabemos solo sus probabilidades, hasta que se mide: la realidad no es independiente del proceso de observación.

Las partículas existen en superposición de estados, puede estar en dos posiciones a la vez y que solo al interactuar con el mundo exterior se decide por una.

Otro límite: los pares de propiedades -por ejemplo posición y velocidad- en el mundo subatómico no se pueden establecer a la vez.

Es lógico que si el universo se expanda, además, toda partícula está en movimiento y sea una onda aunque se vea como corpúsculo.

Cuando se observa un electrón se comporta más como partícula que como onda (partícula es mas parecido a la realidad y onda más aañ sposibilidades).

No existe un “estado objetivo” independiente de la interacción con el entorno.

Las partículas conectadas o generadas juntas no actúan como objetos separados, sino como un solo sistema cuántico: la correlación permanece incluso cuando las partículas se separan. Esto también es dual.

El mundo cuántico no es solo una abstracción matemática, sino una realidad profunda y comprobada que redefine nuestra visión de la naturaleza.