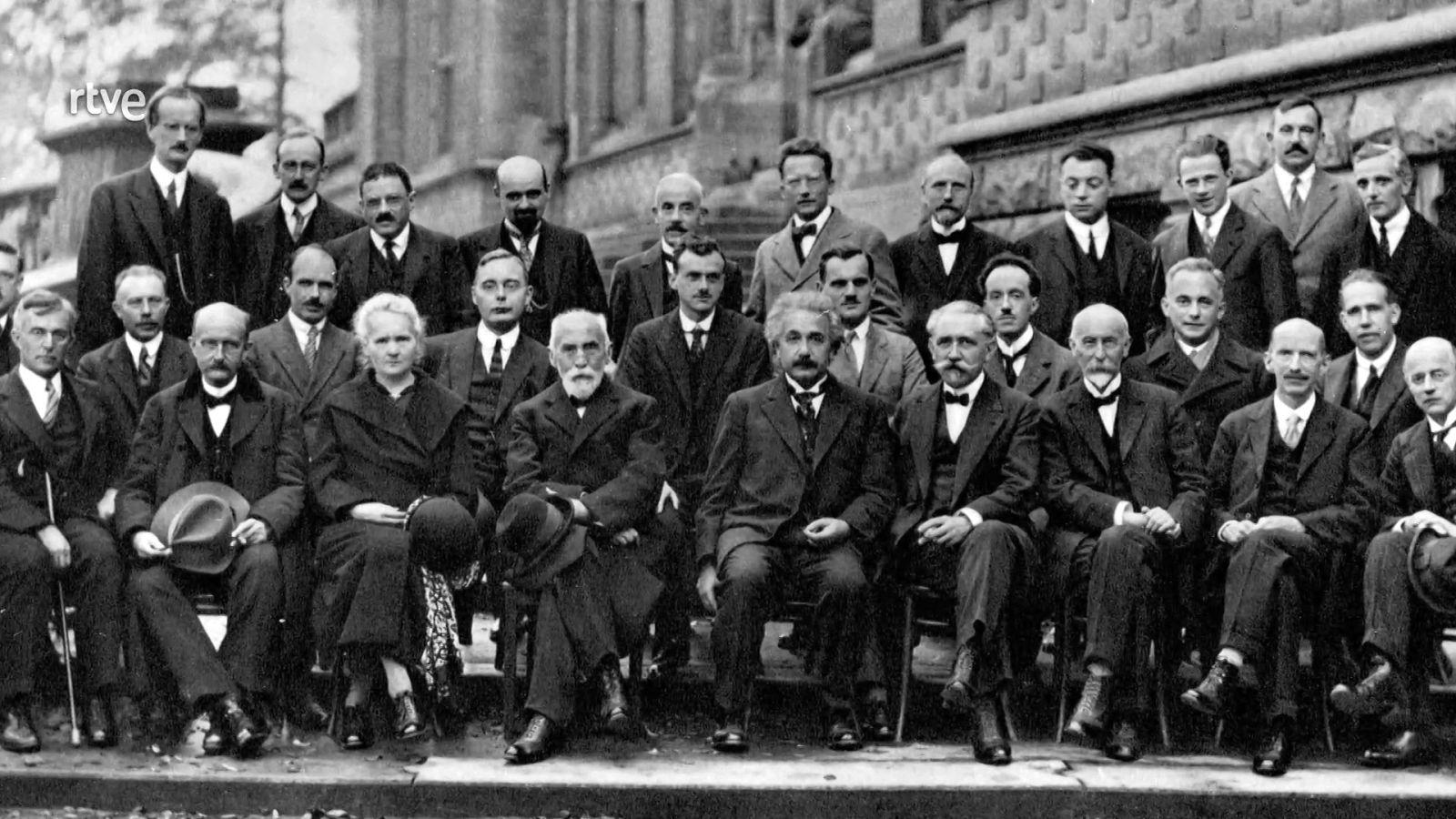

Uno de los momentos clave en la historia de la física llegó cuando a finales del siglo XIX los científicos empezaron a sospechar que la teoría clásica no podía explicarlo todo.

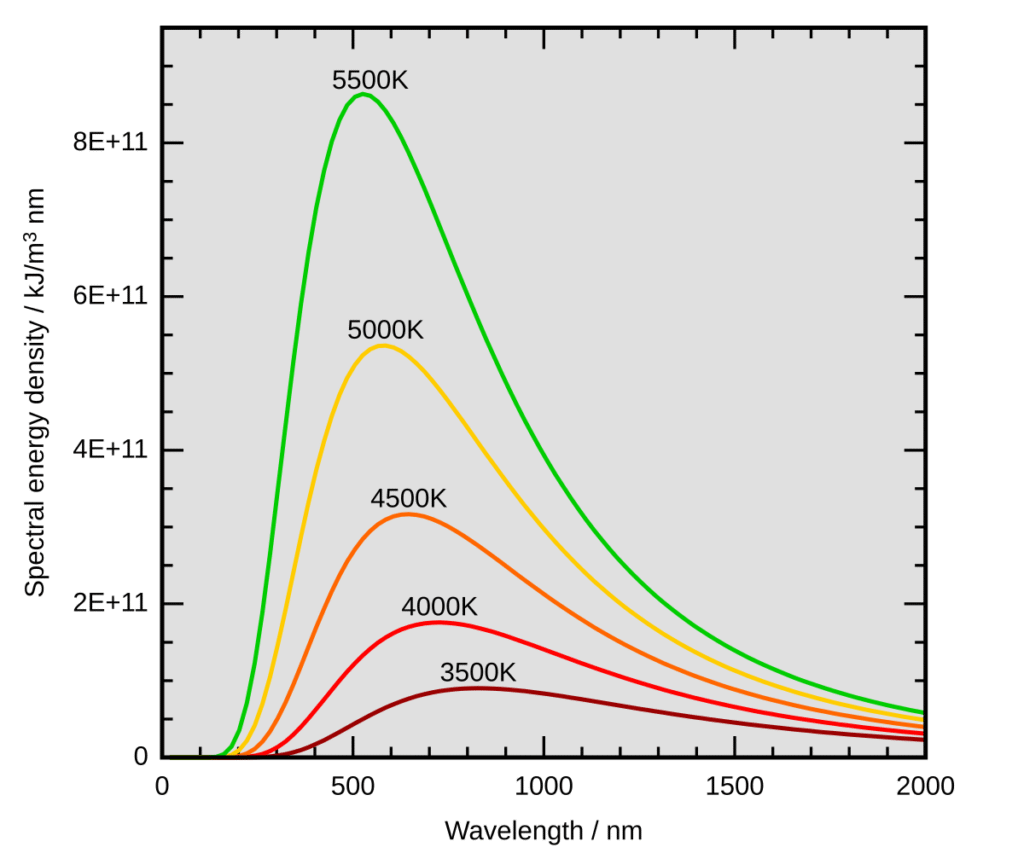

Todo empezó al estudiar cómo emiten luz los cuerpos calientes.

Las teorías predecían algo imposible: que, a frecuencias altas, la energía se dispararía hasta el infinito en lo que se llamó la catástrofe ultravioleta. Un resultado absurdo que chocaba con la realidad.

Entonces, en 1900, el genial Max Planck, en lugar de intentar ajustar la teoría clásica, intuyó un nueva concepción: la energía no fluye de manera continua, sino que se intercambia en pequeños paquetes indivisibles, los cuantos.

De ahí viene la física o mecánica cuántica, un universo contraintuitivo, pero que funcionaba.

Y lo más sorprendente es que no se quedó ahí.

En 1905, Albert Einstein dio un paso aún más audaz. Al estudiar el efecto fotoeléctrico -un fenómeno en el que la luz arranca electrones de un material- se encontró con algo desconcertante que la teoría clásica de la luz como onda tampoco podía explicarlo.

Vio que no importaba cuán intensa fuera la luz que llegara, si su frecuencia no era la adecuada, no ocurría nada. Era como si la energía no llegara de forma gradual y continua, sino en “golpes” bien definidos otra vez

La luz no solo se comporta como una onda, sino también como un conjunto de partículas discretas, cada una con una cantidad fija de energía. A esas partículas las llamamos fotones.

De pronto, revelaba una doble naturaleza, que era dual: ondulatoria y corpuscular al mismo tiempo.

Tras las intuiciones, la pregunta era inevitable: si la energía viene en paquetes y la luz también se comporta como partícula… ¿qué está pasando realmente dentro del átomo?

Se comporta… como es.

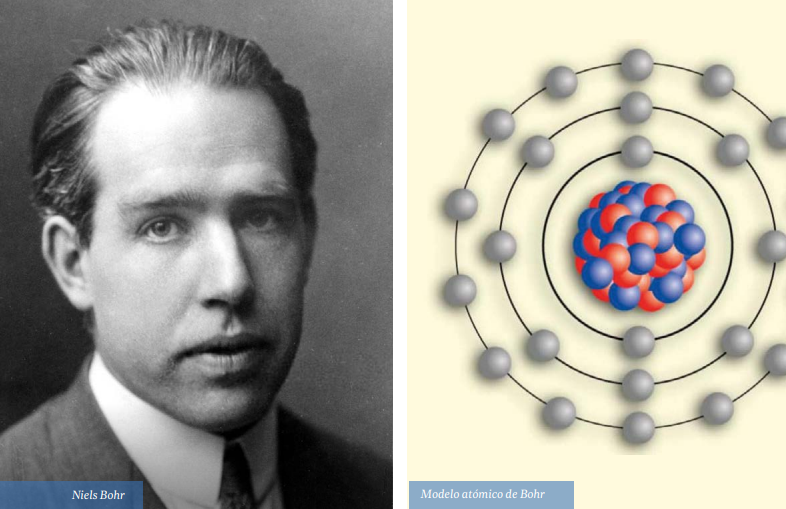

Esto lo demostró de forma magistral en 1913, el físico danés Niels Bohr propuso una idea igual de sorprendente.

Los electrones no pueden ocupar cualquier órbita alrededor del núcleo, como dictaría la física clásica: solo pueden estar en ciertos niveles de energía bien definidos -que se llamaron órbitas cuantizadas-, y cuando absorben o emiten cuantos de luz, saltan de uno a otro, no lo hacen de forma continua, lo hacen de golpe, sin pasar por el camino intermedio.

El átomo, según el modelo de Bohr, lejos de ser un sistema continuo, funcionaba otra vez a “saltos”.

Pero ese modelo era solo el comienzo.

En los años siguientes, la situación se volvió aún más desconcertante. Louis de Broglie lanzó una idea que parecía sacada de ciencia ficción: si la luz -una onda- puede comportarse como partícula, ¿por qué no lo hacían otras partículas fundamentales como ondas?

Y tenía razón. Los electrones también tienen naturaleza ondulatoria. La materia posee una dualidad onda-partícula.

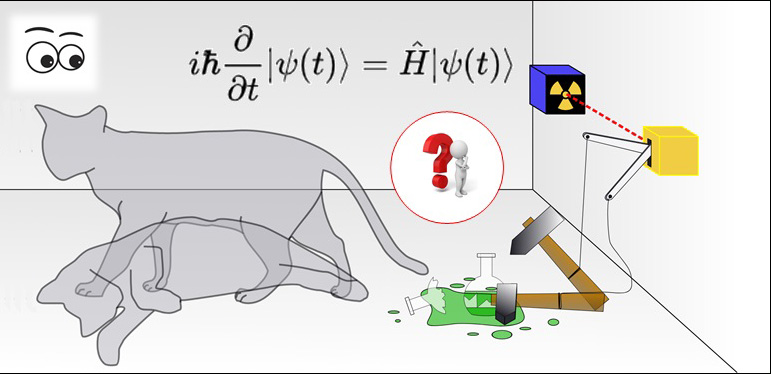

Entonces llegó Erwin Schrödinger, que intentó poner orden en ese caos con su famosa ecuación, pero lo que encontró fue inesperado: una función de onda que no describía trayectorias claras, sino una especie de “nube de posibilidades”.

Ya no podíamos decir exactamente dónde está una partícula, solo dónde es más probable encontrarla.

El estado de una partícula no está definido hasta que se mide, y el acto de medir juega un papel esencial en el resultado observado.

En el mundo cuántico ocurre algo que desafía por completo nuestra experiencia cotidiana. Las partículas -como los electrones- no están en un solo estado definido, como una bola en un lugar concreto.

En realidad, existen en una superposición de estados: una mezcla de todas las posibilidades a la vez.

Es como si, en lugar de elegir un único camino, la naturaleza explorara todos simultáneamente. Pero entonces pasa algo curioso.

Cuando esa partícula interactúa con el mundo -cuando la medimos o la observamos- esa multiplicidad de posibilidades desaparece y solo queda un resultado concreto. Decimos entonces que la función de onda colapsa.

No es que la partícula “decida”, sino que la propia interacción con el entorno obliga a que una de esas posibilidades se haga real, mientras las demás dejan de manifestarse.

Antes de medir, la realidad no está completamente definida.

Después de medir, sí.

El gato de Schrödinger es un experimento mental que lo ilustra: un gato encerrado en una caja, junto a un mecanismo que depende de un evento cuántico, está simultáneamente vivo y muerto hasta que alguien abre la caja, se colapsa, se define por uno de los dos estados que sabemos que son excluyentes.

A la par, Werner Heisenberg formuló el principio de incertidumbre, que establece que no es posible conocer con precisión absoluta y simultánea la posición y la velocidad de una partículas, así como otras propiedades asociadas. No se trata de una limitación técnica, sino de un rasgo fundamental de la naturaleza en su nivel profundo.

Que no podamos definir la posición y la energía de una partícula con precisión infinita implica que si intentáramos comprimir un electrón a un espacio cero, su energía tendría que crecer sin límite, generando fenómenos absurdos que la física real no permite.

Por si fuera poco, Max Born dio el golpe final a la idea de certeza: esa “nube” de Schrödinger no describe algo difuso sin más, sino probabilidades. La física, que durante siglos había sido determinista, se volvía estadística.

Cada partícula ocupa espacio y no puede comprimirse indefinidamente debido al principio de exclusión de Pauli, que establece que dos fermiones no pueden compartir el mismo estado cuántico.

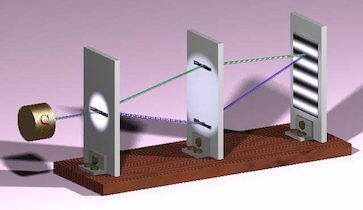

Cabe destacar el experimento más increíble que demostró estos fenómenos: el experimento de la doble rendija.

Cuando electrones o fotones pasan por dos rendijas, no se comportan como pequeñas bolas, sino que generan un patrón de interferencia, típico de ondas y está en superposición, àsa por ambas a la vez.

Sorprendentemente, si se intenta observar por cuál rendija pasa cada partícula, el patrón de ondas desaparece ¡y se comportan como partículas, y se obliga a cada una a definirse y a pasar por 1 rendija! como los objetos normales de la vida.

La mecánica cuántica es la teoría más fascinante y a la vez más comprobada de la historia.

Sin embargo, aún queda por explorar uno de los fenómenos más desafiantes de la física: el entrelazamiento cuántico.

Imaginemos dos partículas que interactúan y luego se separan. Desde la intuición clásica, pensaríamos que cada una sigue su camino con sus propiedades bien definidas, como dos monedas que ya han sido lanzadas y guardan su resultado, cara o cruz, independientemente de lo que ocurra con la otra.

Pero en el mundo cuántico no funciona así.

Cuando dos partículas están entrelazadas, no podemos describirlas por separado, aunque se encuentren a años luz de distancia, y en lugar de comportarse como objetos independientes, forman un único sistema.

Sus propiedades no están fijadas de antemano de manera individual; lo que existe es una especie de relación compartida entre ambas; si una se mide y sale cara, la otra saldría cruz.

Esto fue precisamente lo que incomodó profundamente a Albert Einstein. Junto con Boris Podolsky y Nathan Rosen, formuló en 1935 la conocida paradoja EPR.

Su argumento era que si la mecánica cuántica es correcta, entonces medir una partícula podría determinar instantáneamente el estado de la otra, sin importar la distancia entre ellas.

A Einstein esta idea le resultaba inaceptable. La llamó, con ironía, “acción fantasmal a distancia”.

Según Einstein, la realidad debería ser local, es decir, nada debería influir instantáneamente a distancia, y realista: las propiedades de las cosas deberían existir antes de ser medidas.

Si la mecánica cuántica violaba estos principios, pensaba, entonces debía de estar incompleta y existían “variables ocultas” que aún no habíamos descubierto.

En los años 60, apareció la figura que lo desentrañó, el genio irlandés John Bell.

Formuló unas desigualdades que cualquier teoría basada en esas ideas clásicas debía cumplir, pero si era verdad la mecánica cuántica, en sistemas entrelazados esas desigualdades podían violarse.

Y eso fue exactamente lo que se observó.

Tras los experimentos de Alain Aspect en los años 80, se comprobó que la naturaleza no sigue las reglas clásicas en este punto: el mundo no puede ser a la vez local y realista en el sentido clásico.

Esto no significa que podamos enviar información más rápido que la luz ni que exista una señal misteriosa viajando entre partículas.

En el entrelazamiento, lo que encontramos son correlaciones compartidas que solo se revelan cuando medimos, propiedades (conservación de la energía, el momento y el espín) quedan descritas por una sola función de onda común de un mismo sistema, aunque el espacio las separe.

El universo no parece estar hecho de objetos aislados, sino de conexiones que los unen como tejidas en una red de relaciones.

Este fenómeno es la base de la criptografía cuántica y las futuras redes de comunicación cuántica.

En los últimos años se ha observado con alto control la superposición cuántica en sistemas cada vez más grandes, desde moléculas complejas hasta dispositivos macroscópicos enfriados a temperaturas extremas.

La Interpretación de Copenhague, formulada por Niels Bohr y sus colegas, definió bien esta realidad: los sistemas cuánticos no tienen propiedades definidas hasta que se miden: ¡no existe un “estado objetivo”! independiente de la interacción con el entorno.

En mecánica cuántica, el tiempo sigue estando ahí pero deja de ser un escenario fijo y absoluto en el que todo ocurre.

En lugar de eso, los sistemas cuánticos evolucionan como un abanico de posibilidades que cambian con el tiempo, y solo cuando medimos aparece un resultado concreto. Esto nos deja una idea nueva: en el nivel más fundamental, el tiempo no parece ser un flujo uniforme e independiente, sino una herramienta que usamos para describir cambios.

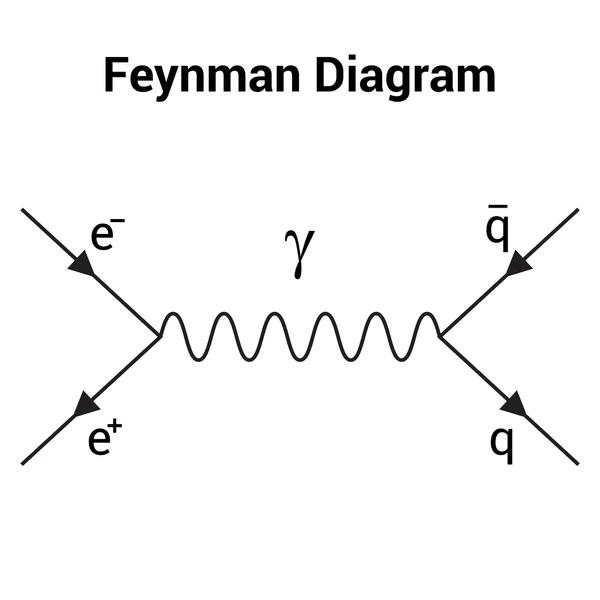

Para seguir con las relaciones de la materia, hay que hablar del gran Richard Feynman, la materia se relaciona principalmente a través de interacciones cuánticas entre partículas, que pueden entenderse como intercambios de “mensajeros” llamados bosones, responsables de las fuerzas fundamentales.

Los electrones, quarks y otras partículas no actúan de forma aislada; su comportamiento está determinado por la probabilidad de que intercambien fotones, gluones o bosones y estas interacciones cuánticas explican cómo se forman átomos, moléculas y estructuras mayores.

Para Feynman, incluso conceptos como la fuerza o el campo son maneras de describir patrones de relación entre partículas, y el mundo material es esencialmente un entramado de intercambios dinámicos de energía y momento, gobernados por las leyes de la mecánica cuántica y expresados elegantemente en sus diagramas de interacción.

No hay evidencia científica de una “conciencia cuántica”; sin embargo, algunas teorías contemporáneas, como la Orch-OR propuesta por Roger Penrose y Stuart Hameroff, sugieren que ciertos procesos cuánticos podrían ocurrir en estructuras llamadas microtúbulos dentro de las neuronas, influyendo en la información que procesa el cerebro.

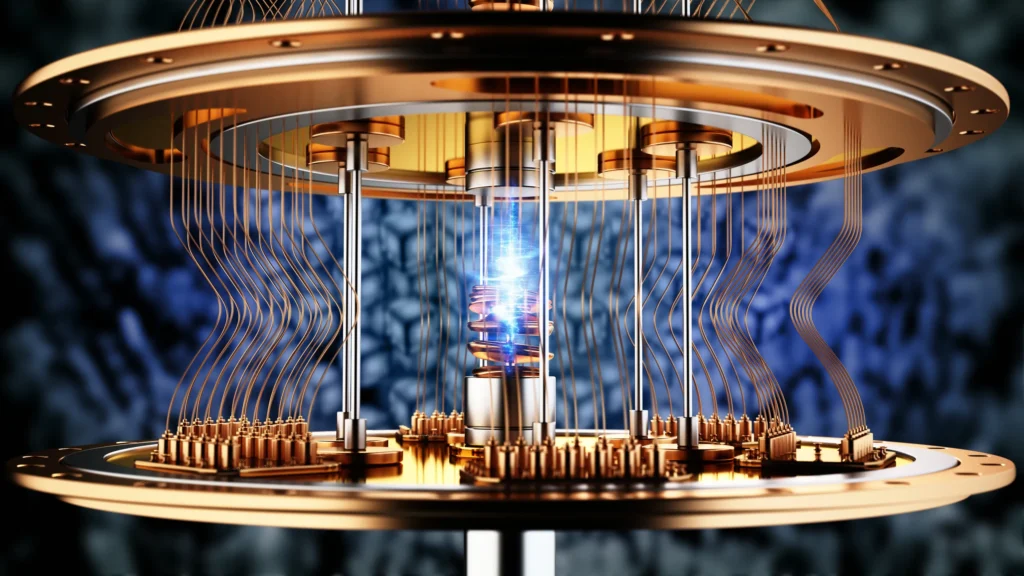

El desarrollo de la computación cuántica ha demostrado de manera práctica la coherencia de esta teoría y actualmente se investigan estados cuánticos colectivos de la materia.